|

(通讯员 大连外国语大学 王靖涵)近日,大连外国语大学软件学院学生团队启动大学生创新训练计划项目“声之形”,面向听障及弱听群体在沟通、环境感知与学习等场景中的现实需求,研发多模态智能交互系统,探索更便捷、更自然的无障碍信息获取与双向交流方式。 项目团队介绍,全球听力健康问题日益受到关注。世界卫生组织(WHO)在相关事实清单中指出,到2050年全球预计将有近25亿人出现不同程度的听力损失,超过7亿人需要听力康复支持。与此同时,我国听障群体规模庞大,沟通“听不清”、安全“听不到”、课堂与职场信息获取不充分等问题仍较为突出。 据项目计划书,“声之形”定位为面向听障人群的全场景一体式增强现实(AR)智能眼镜,强调“看得见、感得到、用得顺”。系统拟通过“语音―文字―手势/手语―触觉”的多通道协同,将多种信息提示以更低的认知负担呈现给用户,帮助其在日常社交、公共出行与学习工作中更及时地获取关键信息。 在核心功能上,系统通过前端拾音阵列与指向性算法,对目标人声进行增强并实时转写为字幕;通过第一人称视角的下向广角视觉单元,识别常用手势与简化手语动作,实现“手势/手语―文字/语音”的双向辅助;同时对车辆鸣笛、救护车警笛、火警等关键环境声进行识别与定位,并以AR方位提示和触觉反馈方式进行预警,提升听障人群的环境安全感知能力。 项目还将探索教育与职场场景的辅助呈现方式,例如课堂实时字幕与要点提取、会议多声源定位与信息记录等,以降低信息获取门槛,促进融合教育与无障碍就业。 据悉,项目由王靖涵担任负责人,刘朝霞教授指导,成员包括张茜雯、安思睿、史晨熙等。下一步,团队将结合校园与社区的真实应用场景推进原型开发与测试验证,持续优化识别稳定性与交互体验,力求形成可落地、可推广的无障碍交互原型。

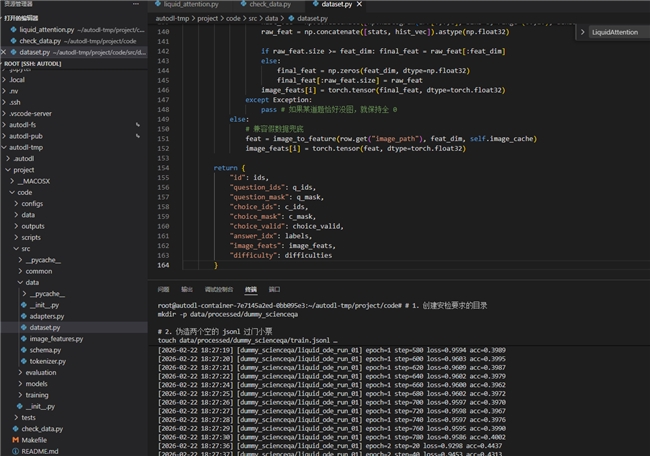

图1 模型数据训练 “让声音被看见,让沟通无边界”――这是团队写在项目愿景中的一句话。团队表示,将以“科技助残”为使命,让技术更好服务于听障群体的平等沟通与安全出行。

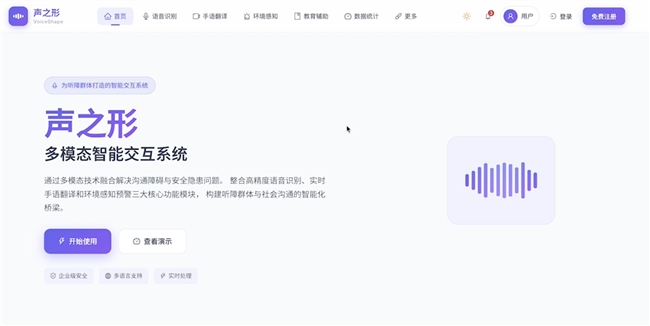

图2 “声之形”系统原型首页(软件原型界面)

图3 语音识别与字幕呈现页面(软件原型界面) |